Bonjour à tous,

Des nouvelles pour décrire ma “nouvelle” infrastructure, 2-3 divagations et les raisons de mon abandon de Proxmox.

Migration de Proxmox à Hyper-V

Crevons l’abcès tout de suite sur le passage de Proxmox à Hyper-V comme c’est certainement ce qui intéressera le plus les lecteurs.

Je n’ai rien à reprocher à Proxmox en tant que tel, PVE fonctionne parfaitement bien et les performances sont excellentes, tout comme la facilité de gestion, je pense qu’avec Hyper-V c’est une des meilleures solutions de virtualisation sur le marché en ce moment.

Il y a toutefois deux gros problèmes avec Proxmox qui ont fini de me gonfler profondément :

- Le système se base toujours majoritairement sur ZFS, comme si Solaris était encore à la mode et que Half Life 2 venait de sortir, alors que BTRFS fonctionne tellement mieux sur du matériel moderne et est parfaitement stable depuis des années.

- Lié au problème numéro 1, les performances de PBS sont absolument merdiques, leur gestion des backups n’aidant pas, mais alors pas du tout, à profiter du matériel moderne.

- Ce n’est pas mieux chez la concurrence, Veeam ou Vembu, par exemple, chez qui le support de PVE est encore un bricolage infâme et qui ne supporte pas ou pas correctement le BTRFS non plus.

- Avoir deux Hyper-V permets de faire de la réplication avec deux serveurs, ce qui est impossible chez Proxmox.

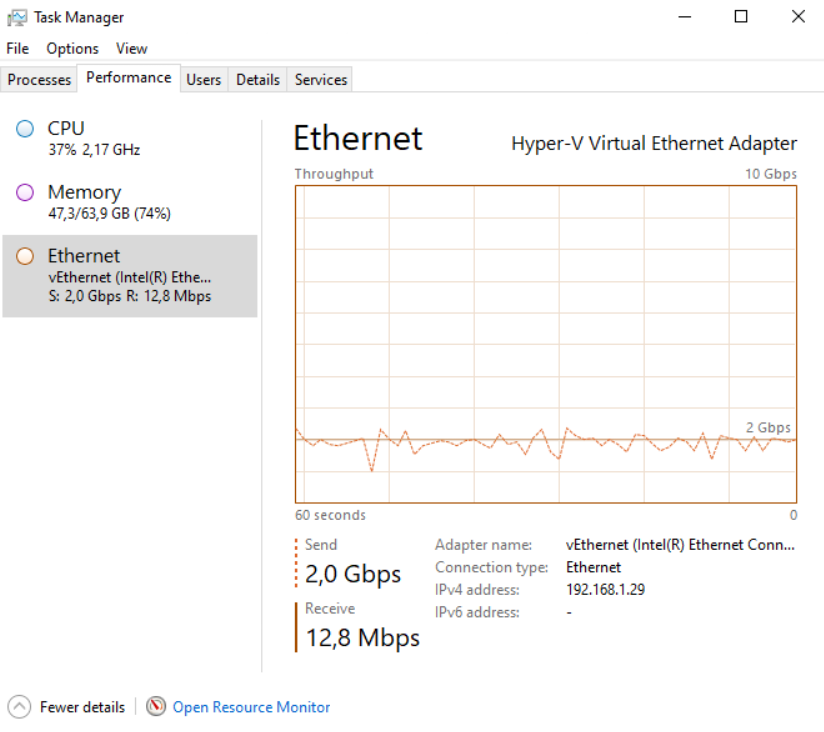

En bref, sur le même matériel, on passe de 100-150 mbps sur la vitesse de backup avec le combo PVE + PBS à 2gbps sur le combo Hyper-V + Veeam.

Quand on a 7-8To de données que l’on sauvegarde quotidiennement comme moi, vous comprendrez le changement de logiciel, PBS était absolument inutilisable.

Le matériel actualisé

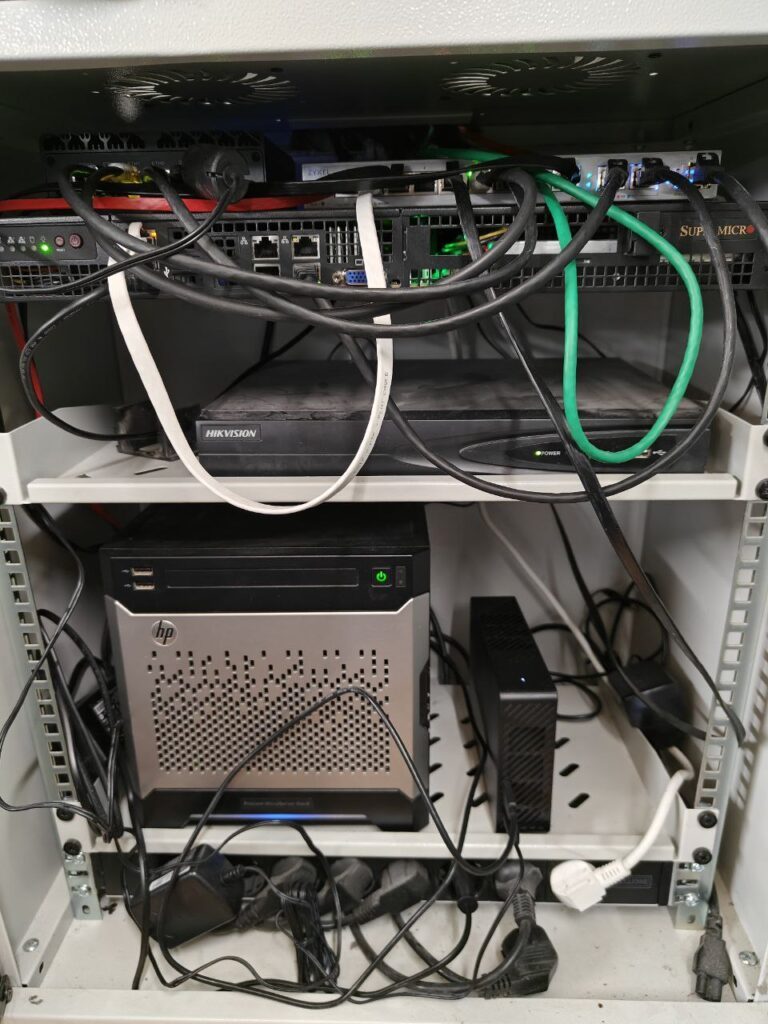

On garde toujours la même équipe, un hyperviseur et un serveur de backup qui commencent tous les deux à devenir des antiquités, mais qui font toujours le job.

Le serveur principal est un Supermicro X10SDV-4C-TLN4F, base Xeon D-1518, consomme peu, c’est parfait en gardant des performances tout à fait correctes avec le stockage suivant (tout en raid 1) :

- 2x Firecuda 530 Nvme 1To pour l’OS et les machines virtuelles

- 2x Seagate Exos X16 14To pour les films et les gros fichiers

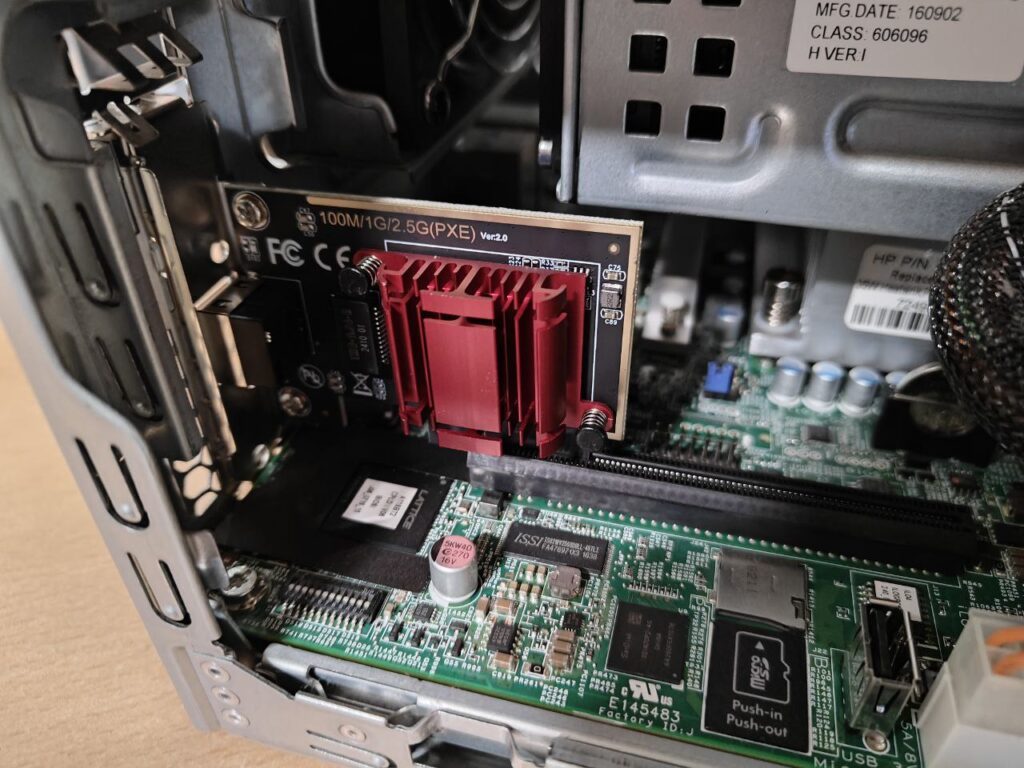

Le serveur de backup est mon très vieux HP MicroServer Gen8 (on en parlait en 2017 ici : https://www.abyssproject.net/2017/03/preparation-dun-hp-microserver-gen-8-servir-de-nas/)

Entre temps, je lui ai ajouté une carte réseau 2,5gbps RTL8125B pour profiter de mon réseau en 10gbps avec le stockage suivant (toujours en raid 1) :

- 2x WD Red SA500 500Go pour l’OS

- 2x Seagate Exos X16 16To

Au niveau de l’OS, on est sur du Windows Server 2022 sur les deux machines.

Je me suis également reconditionné un APC C1500 que j’avais récupéré HS pour me servir de nouvel UPS, il éteint automatiquement l’hyperviseur avec powerchute en cas de panne électrique.

Les machines virtuelles

Vous pouvez reposer vos fourches et vos commentaires acerbes pour cette partie, on repart sur du Debian (on ne change pas ce qui marche).

Je ne me suis pas encore attaqué à Debian 13, tout est donc sous Debian 12 ici.

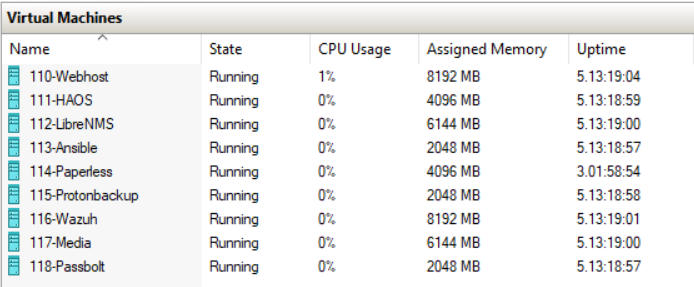

Voici la liste des machines virtuelles que j’utilise :

- Ansible : Serveur Ansible de contrôle de l’infrastructure avec une interface Semaphore

- LibreNMS : Monitoring de l’infrastructure, toujours et encore, quasiment 10 ans que je m’en sers : https://www.abyssproject.net/2016/06/installer-librenms-debian-8-check-nagios/

- HAOS : Serveur Home Assistant pour la domotique maison (le seul qui n’est pas sous Debian donc, mais sous HAOS)

- Paperless : Ma GED maison avec paperless-ngx, c’est ça de devenir vieux, on a besoin d’une GED pour encadrer son merdier administratif.

- Media : Serveur Jellyfin (ceux qui savent savent)

- Passbolt : Mon gestionnaire de mot de passe en remplacement de bitwarden, qui devenait compliquer à gérer en auto-hébergement avec les licences pour l’utilisation familiale.

- Proton-backup : Serveur de backup de mes emails prontonmail

- Wazuh : Serveur pour l’hébergement de mon SIEM / XDR

- Webhost : Le serveur web qui héberge ce blog, toujours la même stack technique depuis longtemps aussi.

Peu de changements ici, hormis que l’OPNSense est passé sur un petit NUC physique sur base intel N100. J’ai toujours eu des soucis de performances en virtualisation sous Proxmox et je n’ai pas retenté avec Hyper-V.

Dans la globalité, peu de changements, on garde ce qui marche ici, il y a surtout des ajouts au fur et à mesure que j’ai besoin de nouveaux outils, notamment pour la sécurité avec Wazuh, la ged ou la domotique.

Tout est donc hébergé à la maison maintenant, derrière Cloudflare, j’avais détaillé tout cela ici : https://www.abyssproject.net/2024/11/auto-hebergement-derriere-cloudflare/

Le réseau

J’ai tout refait en catégorie 6 STP au niveau du câblage, on est donc sur 10gbps dans toute la maison.

Le réseau est basé sur des Zyxel XGS1250-12, le supermicro dispose de ports 10gbps d’origine, et j’ai ajouté du 2.5gbps sur le microserver.

Au niveau du firewall, j’ai mis l’OPNSense sur un routeur aliexpress avec 4 ports 2.5gbps avec une puce Intel N100, je n’ai pas encore la fibre et je n’ai pas prévu de pouvoir utiliser plus que cela en utilisation réelle de toute façon.

L’automatisation de l’infrastructure

J’ai déjà beaucoup parlé de Ansible sur ce blog : https://www.abyssproject.net/?s=ansible

La nouveauté, c’est que tout utilise l’interface Semaphore maintenant :

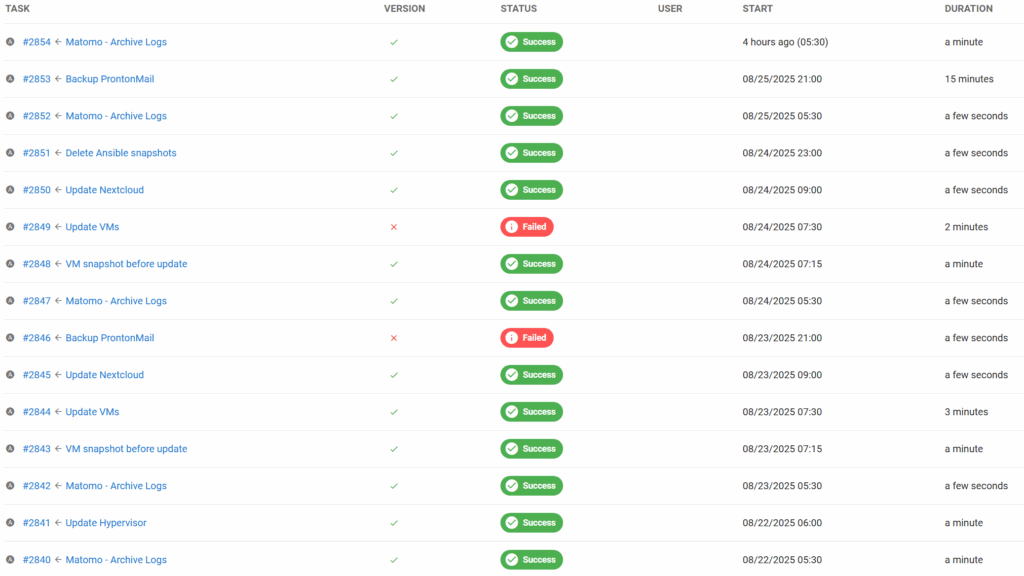

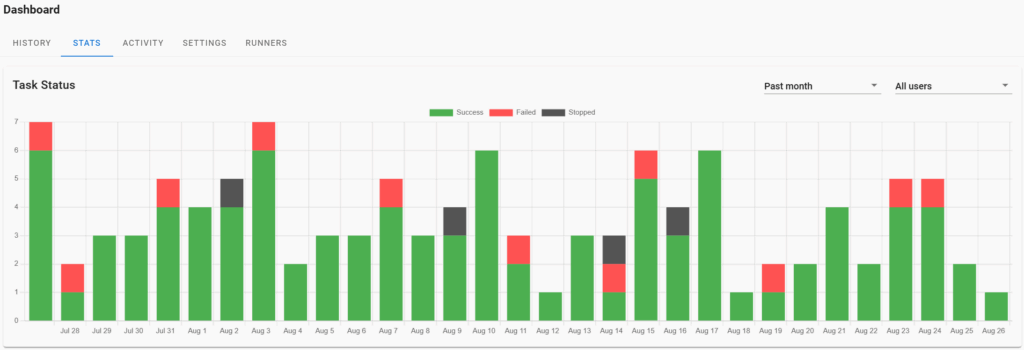

En vrac, tout est géré par ici sauf les mises à jour de mon OPNSense qui sont automisés directement dans son cron local :

- La mise à jour des serveurs physiques et virtuels (avec snapshots, nettoyage des snapshots, etc …)

- Les mises à jour de Nextcloud

- Le backup de mon compte protonmail (les jours où hydroxide est coopératif : https://www.abyssproject.net/2021/04/backup-headless-de-ses-emails-protonmail-sous-debian-10/)

- La gestion des logs du Matomo, imports et archives automatiques

- La gestion du Wazuh, mise à jour des agents et clean des indexs.

Je reçois des mails en cas d’échec, sinon tout se fait sans moi.

La gestion des sauvegardes

Un beau bordel la gestion des sauvegardes, voici ce que j’ai monté maintenant que tout est chez moi.

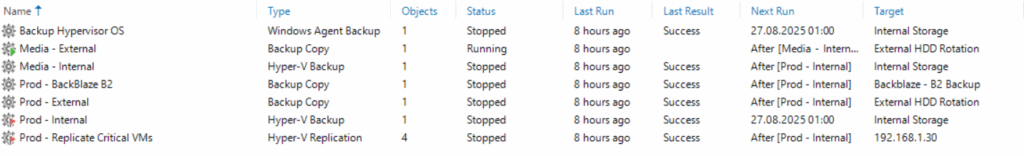

J’ai un agent Veeam qui sauvegarde l’OS de l’hyperviseur dans un premier temps.

Ensuite, tout est séparé entre la production (comprendre toutes les machines) et mon serveur media (Jellyfin).

- Une première sauvegarde est faite sur le stockage local du MicroServer.

- Une seconde sauvegarde part sur une rotation de disques externes.

- Une troisième sauvegarde part dans le cloud BackBlaze B2, hormis pour les medias.

- Et j’ai enfin une réplication des machines critiques qui se fait sur le microserver au cas où le supermicro me lacherait (Webhost, Paperless, HAOS et Passbolt).

Niveau protection, dans tous les cas les sauvegardes sont chiffrées par Veeam.

Le stockage est également chiffré avec Bitlocker sous Windows (Interne ou Externe).

Le stockage Backblaze est également chiffré au niveau du bucket S3 (https://www.backblaze.com/docs/cloud-storage-enable-encryption-on-a-bucket)

On respecte donc la fameuse règle du 3-2-1 (https://www.veeam.com/blog/fr/321-backup-rule.html), la rotation de disque étant sortie et hors-ligne et tout est chiffré 2 fois.

Le wiki

Je n’en ai pas trop parlé pour le moment, mais j’ai lancé un wiki (bilingue en plus, je voulais aussi ajouter l’allemand et l’italien, mais je manque de temps) : https://wiki.abyssproject.net/

Un wordpress est compliqué pour l’écriture d’article technique, spécialement quand on commence à intégrer des scripts dans l’écriture, le markdown permet une gestion plus facile et le système xWiki permet de se passer de la gestion du SEO, je gagne du temps et je peux mettre plus de choses.

Je peux également me passer des dates de publications et actualiser les articles continuellement.

L’arrivée de l’IA et le manque d’articles sur le blog

En plus d’un manque de temps et de motivation, l’arrivée de l’IA est une bonne raison qui m’a fait arrêter net dans le développement de ce blog, tout étant pompé par les IA.

Écrire pour que cette merde de Gemini notamment réalise des résumés foireux en haut des recherches Google et fasse disparaitre les bonnes informations est une catastrophe totale.

Ceci étant dit, je ne m’inquiète pas trop pour l’arrivée de l’IA dans notre métier pour les raisons suivantes :

- Si on ne sait pas ce que l’on veut ou que l’on ne sait pas l’expliquer, l’IA ne donnera pas de bons résultats (Gemini, chatgpt, Perplexity, etc …)

- Les résultats retournés peuvent être catastrophiques, spécialement lors de l’écriture de scripts, si on n’arrive pas à comprendre les résultats, on peut clairement torcher une infrastructure.

- Chatgpt est une grande réussite pour l’écriture de scripts catastrophiques, Perplexity se débrouillant nettement mieux.

On a bien des clients qui ont tenté de nous remplacer avec, mais pour l’instant ce n’est pas concluant :

En fait, le métier le plus à risque est celui de développeur pour moi (en restant dans l’informatique).

On avait déjà accepté une merdification de tout le développement logiciel en grande partie avec l’externalisation vers l’inde, maintenant que tout va passer de plus en plus par GitHub Copilot et autres, on va en fond de 5ᵉ dans le mur.

La bonne nouvelle, c’est que comme une bonne partie du contenu sur internet est généré par IA et que l’IA s’entraine désormais sur elle-même, les modèles commencent à faire de l’autophagie et à se corrompre eux-mêmes, l’IA va donc dans le mur aussi si les résultats ne sont pas filtrés correctement avant les entrainements et qu’il n’y a plus d’humains pour fournir un support de base qui vaut quelque chose (on en revient au début de cette section).

Je ne suis pas contre l’IA, comme toute nouvelle technologie, c’est la jungle, il y a des abus et cela va se réguler tout seul d’ici à quelques années, comme les cryptos ou les NFT l’ont fait (qui se souvient encore des NFT dans l’audience ?).

De mon côté, j’ai un perplexity pro qui m’aide surtout quand j’ai besoin de condenser beaucoup d’informations ou pour l’écriture de gros scripts PowerShell (mais il est incapable de faire ces derniers tout seul).

Je gagne du temps dans mon métier, mais ça s’arrête ici.

La suite

Vous l’aurez compris, je n’ai pas prévu d’écrire beaucoup plus sur ce blog, en tout cas pas pour le moment, toutefois je n’ai pas non plus prévu de le mettre hors-ligne.

On verra l’évolution d’internet d’ici à quelques années, beaucoup de blogs de copains de l’époque sont morts, globalement tous ceux sur la page d’accueil du site ou du wiki, en même temps entre les IA et les réseaux sociaux, je serais curieux de savoir combien de moins de 25 ans peuvent donner la définition d’un blog ? (vieux con détecté).

J’ai aussi complètement lâché mes flux RSS à cause de toutes ces morts de blog et de Nextinpact qui avait flingué son flux à un moment.

C’est un peu pareil pour le Journal du hacker, entre une grosse panne et des comptes qui se sont mis a généré du contenu complètement merdique généré par IA et à remplir le flux avec ça.

En réalité, maintenant ma veille se fait via les copains en direct, les news constructeurs, LinkedIn et deux-trois autres sites.

On verra ce que la suite nous réserve 🙂

Très intéressant,

2 petit points :

Merci 😉

Bonjour

Pour répondre aux questions :

– Voir la première ligne du wiki officiel de Proxmox qui est assez explicite sur le support de BTRFS : https://pve.proxmox.com/wiki/BTRFS

– Ne pas confondre réplication, migration de vm et clusters qui sont 3 choses différentes (sans compter que Ceph n’aurait aucune utilité dans ce cas précis, voir encore la première ligne de ce lien : https://pve.proxmox.com/wiki/Deploy_Hyper-Converged_Ceph_Cluster#_recommendations_for_a_healthy_ceph_cluster)

Bonjour,

Très intéressant, mais quid du coût de licence exponentiel de Windows Server suivant le nombre de VM, de CPU et de cœurs. Je me pose aujourd’hui exactement les mêmes questions que vous pour migrer mais le cout total peut être rédhibitoire rapidement.

Bonjour,

Des calculateurs existent pour cela : https://wintelguy.com/windows-server-licensing-calc.pl

Globalement au-dessus de 10 vms, il faut passer sur du datacenter, ce qui enlève tous coûts supplémentaires, le nombre de vms devenant illimités.

Pour la question des CPU, on bloque quasiment tous les serveurs que l’on livre à 16 cœurs, on voit sur notre monitoring que l’utilisation cpu est toujours extrêmement basse, même sur les serveurs de développements.

On enlève donc les licences additionnelles pour les cœurs.

Merci de la réponse.

Et bien cela me rassure, je suis arrivé aux mêmes conclusions, j’ai fait les mêmes choix en terme de CPU et de cœur et de licences.

Très sympa comme article.

Perso j’ai remplacé proxmox par incus en cluster il y a quelques temps, et franchement ça fonctionne super bien, même pour de la VM windows.

Bonjour,

Merci pour le retour, je n’avais jamais entendu parler d’Incus, je regarderai.

Si c’est du KVM, ça ne m’étonne pas que Windows marche bien dedans.

Vous utilisez btrfs dans les VM debian ?

Non, dans des VMs j’utilise ext4 ou UFS, jamais ZFS ou BTRFS, il n’y a pas d’intêret pour moi.

Pour opnsense, je suis passé d’une machine physique a une VM proxmox. Ça fonctionne très bien, même le pci passthrough de la carte réseau. J’avais un pb de débit, mais c’était lié à mon choix de carte réseau virtuelle de la VM. En changeant le type de carte je suis passé de 100Mb/s à 1gb/s.

Cela fonctionne, mais j’ai toujours eu un usage CPU supérieur en virtuel sur OPNsense.

J’ai donc pris un nuc pour la maison et en professionnel, on revend directement le matériel de Deciso.

Bonjour, que reproches-tu as ZFS que BTRFS fait mieux ?

Bonjour, – ZFS utilise toujours une quantité significative de RAM pour du cache qui détruit les performances du matériel moderne (c’était visible sur SSD, c’est flagrant sur NVME). Arc c’était bien il y a 20 ans, mais ça n’a pas évolué et ça ralenti tout de nos jours. – Les IOPS et les latences, toujours sur NVME, sont misérables avec ZFS. – Le support pour le matériel moderne, par exemple, les disques avec la technologie SMR est carrément refusé. – Les développeurs de ZFS sont des vieux de la vieille, coincés dans leurs croyances quasi millénaires et ne veulent rien… Voir plus »

Merci pour ce retour de passage de proxmox à hyper-v !